Концепция проекта

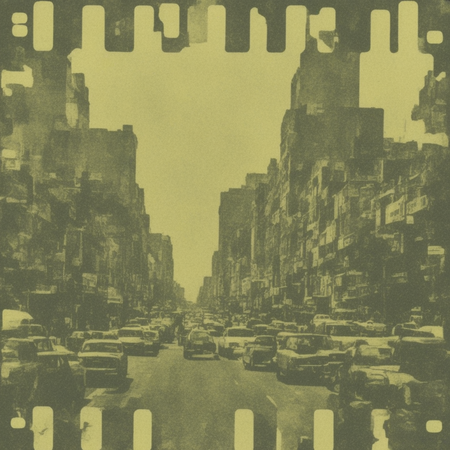

Центральная идея проекта — создание изображений с эффектом старой киноплёнки. Мне хотелось передать ощущение кадра, извлечённого из прошлого: с мягкостью изображения, характерным цветовым искажением и визуальными следами материальности.

Такой эффект формирует особое восприятие изображения — как будто фрагмент памяти или кадр из архивного фильма, где важны атмосфера и ощущение времени.

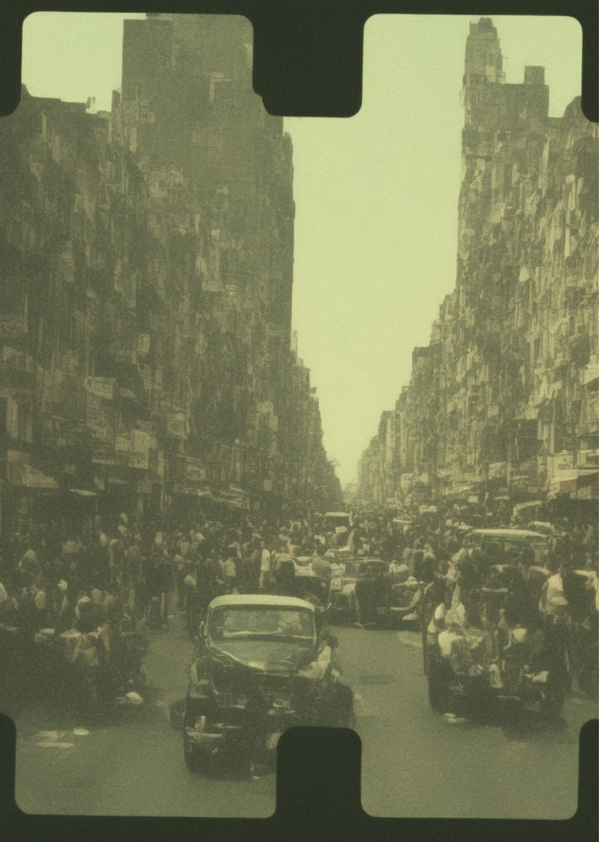

Исходные изображения

Для обучения был собран датасет из 52 изображений с фотостока Unsplash с открытой лицензией «Unsplash License», которая разрешает свободное использование изображений в любых целях.

В выборку вошли разные изображения: портреты, городские сцены, повседневные сюжеты и природные пейзажи. Основным критерием отбора стало наличие характерных признаков плёночного изображения — мягкость, зернистость и рамка кадра.

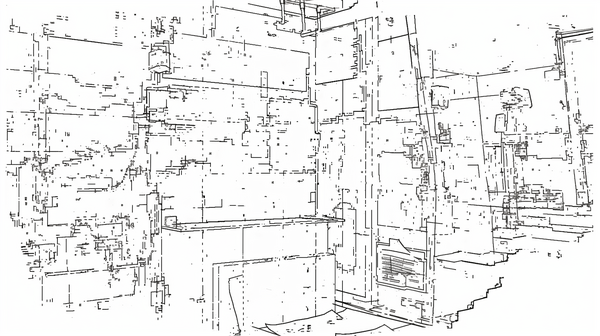

Процесс обучения

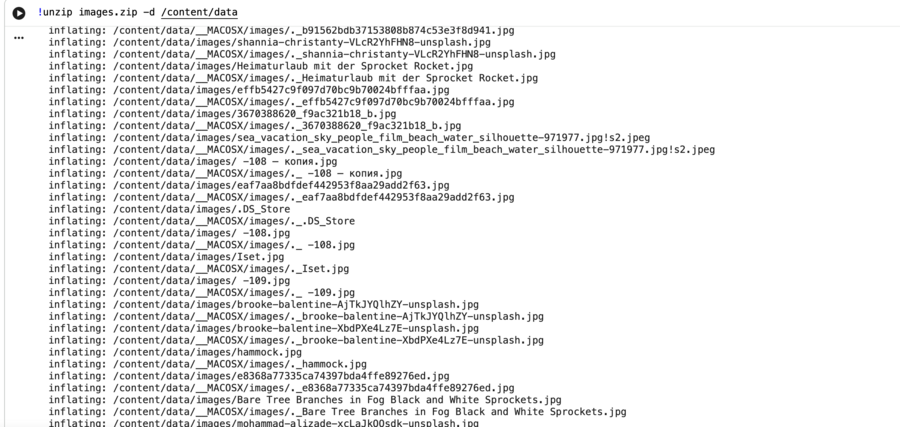

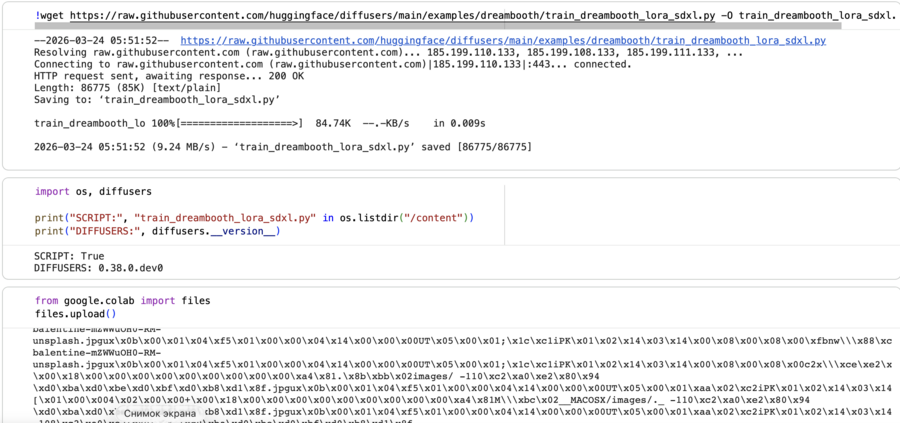

Сначала я подготовила рабочую среду в Google Colab и установила библиотеки, необходимые для обучения модели Stable Diffusion XL. На этом этапе подключались инструменты для работы с LoRA, accelerate и diffusers, чтобы адаптировать базовую генеративную модель под собственный визуальный стиль.

После я загрузила пример обучающего скрипта DreamBooth LoRA для SDXL из репозитория Hugging Face. Это позволило использовать готовую архитектуру обучения и адаптировать её под собственный датасет и выбранную визуальную задачу.

А после, я загрузила архив с изображениями и распаковала его в рабочую директорию. Затем датасет был приведён к нужной структуре: были удалены служебные файлы, а сами изображения собраны в единую папку для дальнейшего обучения модели.

Основной этап работы — запуск обучения модели Stable Diffusion XL с помощью метода DreamBooth LoRA. В качестве обучающего описания использовался prompt, связанный с эстетикой плёночного кадра, а сама модель обучалась на пользовательском датасете в среде Google Colab.

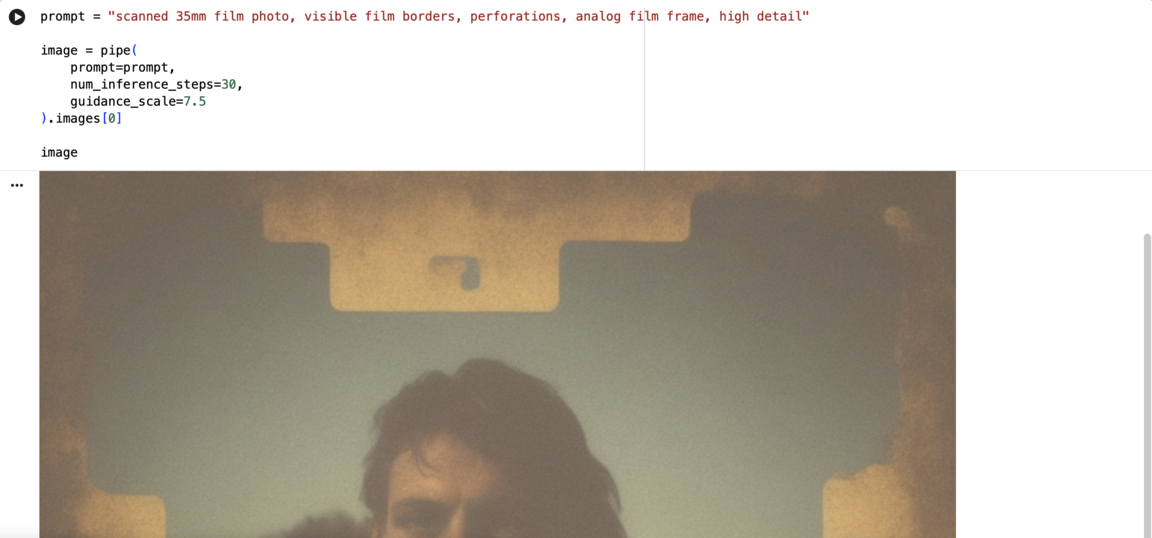

После завершения обучения я подключила полученные LoRA-веса к базовой модели Stable Diffusion XL. Это позволило использовать уже обученный визуальный стиль при генерации новых изображений без полного переобучения модели. На финальном этапе модель использовалась для генерации новых изображений по текстовым запросам.

Результат генераций

1. prompt = «portrait in filmframe style, 35 mm film frame, sprocket holes, cinematic analog photo» 2. prompt = «35mm film strip with ONE frame, large sprocket holes, portrait of a young man

prompt = «urban life scene inside film strip, strong borders, perforations visible, modern colors»

1.prompt = «fashion portrait, model inside film strip frame, strong borders, vibrant colors» 2. prompt = «scanned 35 mm film photo, visible film borders, perforations, analog film frame, high detail»

prompt = «full 35 mm film frame filling image, thick black borders, sprocket holes, beach scene with people inside, vivid blue water»

prompt = «full 35 mm film frame, sprocket holes extremely clear, thick black border, modern color photo inside (teenagers, beach, city)»

prompt = «friends on vacation, summer scene inside film strip frame, perforations visible»

Анализ результата

Итогом работы стала серия изображений, выполненных в единой визуальной стилистике, имитирующей эстетику аналоговой киноплёнки. Основной задачей было добиться устойчивого воспроизведения характерной рамки кадра с перфорацией, а также переноса визуальных свойств старой фотографии на новые сцены.

В результате обучения модель научилась достаточно стабильно воспроизводить плёночную рамку, включая затемнённые края и характерные отверстия по бокам. В некоторых генерациях рамка выглядит чётко и графично, в других — слегка размыта или интегрирована в изображение, что создаёт более естественный эффект «снятого на плёнку» кадра.

Цветовая обработка изображений также демонстрирует признаки усвоенного стиля: наблюдается снижение контраста, мягкость переходов и склонность к тёплым или приглушённым оттенкам. Это усиливает ощущение винтажности, однако в ряде случаев приводит к излишней блеклости изображения и потере деталей.

Также можно отметить, что модель не всегда одинаково точно воспроизводит рамку — в некоторых случаях она деформируется или появляется не полностью. Это может быть связано с ограниченным размером датасета и разнообразием исходных изображений.

В целом результат можно считать успешным: модель переняла ключевые визуальные характеристики старой киноплёнки и способна применять их к новым изображениям, сохраняя стилистическую целостность и вариативность генераций.

Описание применения генеративной модели

Stable Diffusion XL 1.0 Использовалась как базовая генеративная модель для синтеза изображений. Она обеспечивает высокое качество генерации и позволяет работать с детализированными сценами и сложными визуальными стилями.

DreamBooth + LoRA Использовались для дообучения модели под конкретный визуальный стиль. DreamBooth позволил закрепить особенности плёночной эстетики, а LoRA — реализовать это более эффективно, обучая только часть параметров модели и снижая нагрузку на вычислительные ресурсы.

AutoencoderKL (VAE) Используется внутри Stable Diffusion для кодирования изображений в латентное пространство и их последующего восстановления. Этот компонент обеспечивает корректную генерацию и передачу визуальных деталей.